AIエージェント入門|ローカルLLMでマルチエージェントを構築する【第4週】では、Planner と Worker に役割を分けたマルチエージェント構成を作り、AIを“チーム”として動かす考え方を学びました。

ここまでで、AIエージェントの内部構造はかなり整理できています。

しかし、実際のAIエージェントは、内部で考えるだけでは十分ではありません。

ファイル、データベース、検索、外部ツールなど、外部の情報や機能と接続して初めて実用性が高まります。

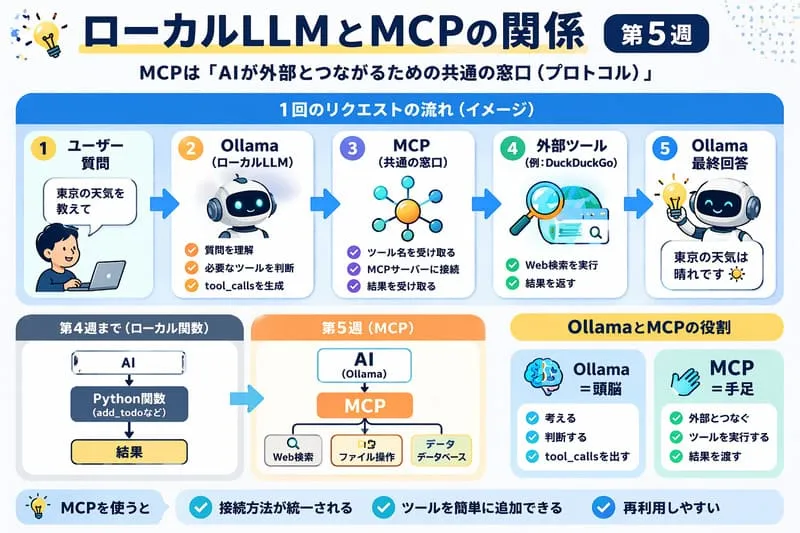

そこで第5週では、AIアプリと外部システムをつなぐための標準である MCP(Model Context Protocol) を学びます。

MCPは、AIアプリが外部データソースやツール、ワークフローと接続するためのオープンな標準です。

AIエージェントとは

AIエージェントは、判断して動くだけでなく、外部ツールやデータと接続して初めて実用性が高まります。

第5週では、AIアプリと外部システムを標準的につなぐ仕組みであるMCP(Model Context Protocol)の基本と、ローカルLLM環境での扱い方を学びます。

学習ロードマップ(拡張版)

| 週 | 内容 |

|---|---|

| 第1週 | チャット + JSON出力 |

| 第2週 | ツール呼び出し |

| 第3週 | ループ型エージェント |

| 第4週 | マルチエージェント |

| 第5週 | MCPで外部とつなぐ |

第5週のゴール

この週では、AIエージェントを外部と接続する考え方を理解します。

- MCPが何のための仕組みか分かる

- これまでの「ローカル関数呼び出し」との違いが分かる

- ローカルLLM中心の構成で、MCPをどこに組み込むか理解できる

MCPとは何か?

MCPは「AIと外部をつなぐ標準」

MCP(Model Context Protocol)は、AIアプリを外部データやツール、ワークフローと接続するためのオープンな標準です。

公式 docs でも、Claude や ChatGPT、Gemini のようなAIアプリが、ローカルファイル、データベース、検索、計算機などの外部システムに接続できる仕組みとして説明されています。

参考:What is the Model Context Protocol (MCP)?

なぜMCPが必要なのか?

これまでの構成

第4週まででは、AIはPythonコードの中に用意した関数を呼び出して処理を行っていました。

AI

↓

ローカル関数

↓

結果を受け取るこの構成は、仕組みを理解するにはとても分かりやすく、AIエージェントの学習には最適です。

ただし、使える範囲はそのPythonプログラムの中だけに限られます。

何に限界があるのか

例えば、次のようなことをやりたくなります。

- ローカルファイルを読む

- データベースから情報を取得する

- 外部検索や社内ツールを使う

- 別のアプリやワークフローとつなぐ

こうした接続先を毎回バラバラに実装すると、ツールごとに接続方法が異なり、再利用しにくくなります。

MCPは、こうした接続を標準化するために設計されています。

MCPでどう変わるか

AI

↓

MCP(共通の窓口)

↓

外部ツール / データ / APIMCPを使うことにより、以下のメリットが生じます。

- 接続方法が統一される

- ツールを簡単に追加できる

- 再利用しやすくなる

これまでの「tools」とMCPの違い

ローカル関数呼び出し

AIエージェント入門第2週〜第4週では、Pythonコード内で定義した関数をLLMが選び、Pythonがその関数を実行する形でした。

Ollamaは tool calling をサポートしており、Qwen 3 などの対応モデルで関数呼び出しを使えます。

MCP接続

MCPでは、その“呼び出し先”が単なるローカル関数ではなく、外部の標準化されたサーバーや機能群になります。

つまり、toolsとMCPでは以下の違いがあります。

- tools = 今のアプリの中で動く道具

- MCP = 外の世界とつながるための標準窓口

これまで

AI → ローカル関数 → 結果

MCP導入後

AI → MCP → 外部ツール / 外部データ / ワークフロー

この分担によって、エージェントは外部データやツールを活用できるようになります。

ローカルLLMとMCPの関係

Ollamaはどこに入るのか

今回の作業では、LLM自体は Ollama 上のローカルモデルを使います。

Ollamaはローカルでモデルを実行し、tool calling をサポートしています。

つまり構成としては、次のように考えると分かりやくなります。

Pythonアプリ

↓

Ollama上のローカルLLM(qwen3系など)

↓

MCP経由で外部機能に接続MCPはLLMそのものではなく、LLMが外部とつながるための仕組みです。

実装イメージ

第5週では、まずMCPの仕組みを理解します。

いきなり複雑なMCPサーバーを作るより、まずはMCPの仕組みを理解して実装作業を行った方が整理しやすいからです。

LLMでMCPを使う流れは以下の様になります。

ユーザー入力

↓

ローカルLLMが判断

↓

必要ならMCP経由で外部ツールに依頼

↓

結果を受け取る

↓

最終回答第5週のまとめ

この週では、AIエージェントを外部ツールやデータとつなぐための考え方として、MCPの基本を学びました。

MCPは外部接続の標準であり、AIアプリを、ツール・データ・ワークフローとつなぐためのオープンな仕組みです。

第5週では、MCPの役割と位置づけを理解しました。

次は、実際に ローカルLLM + Python + MCPサーバー という形で、より具体的な接続手順に進みます。