Gemma 4は、Googleが2026年4月2日にリリースした、最新のオープンウェイトAIモデルのファミリーです。

Googleの最上位AIである「Gemini 3」と同じ技術(リサーチとテクノロジー)をベースに構築されており、従来のオープンモデルの常識を覆す高い推論能力と、開発者にとって非常に扱いやすいライセンス体系が特徴です。

今回の世代では、論理的に考える力が大きく向上しただけでなく、画像を理解できるマルチモーダル機能も標準で備わっています。

この記事では、こうしたGemma 4の特長を踏まえ、最新のLM Studio環境で上手に活用するためのポイントを分かりやすくまとめています。

Gemma 4 とは

Gemma 4は、Googleの最先端AI「Gemini」シリーズと同じ技術スタックで構築されています。

主な特徴

- Apache 2.0 ライセンスの採用:

Gemma 4から、完全にオープンソースな「Apache 2.0」ライセンスに変更されました。

これにより、商用利用、改変、再配布がこれまで以上に自由に行えます。 - 「パラメータあたりの知性」の向上:

小規模なモデルでありながら、その数十倍のサイズを持つ旧世代の大型モデルに匹敵する性能(Reasoning、数学、コード生成など)を実現しています。 - ネイティブ・マルチモーダル:

テキストだけでなく、画像や動画を標準で理解できます。さらに一部のモデルでは音声入力にもネイティブ対応しています。 - エージェント特化型:

ツール実行(Function Calling)や構造化データ(JSON)の出力能力が高く、自律的なAIエージェントの開発に適しています。

モデルのラインナップ

用途に合わせて4つのサイズが提供されています。

| モデル名 | パラメータ数 | 特徴 | コンテキスト長 |

| Effective 2B (E2B) | 約5.1B (実効2B) | スマホ・IoT向け。音声入力対応。 | 128K |

| Effective 4B (E4B) | 約8.0B (実効4.5B) | エッジデバイス向け。高い画像認識能力。 | 128K |

| 26B MoE | 25.2B (実効3.8B) | 初のMoE構成。低レイテンシで高速。 | 256K |

| 31B Dense | 30.7B | シリーズ最高性能。ファインチューニングに最適。 | 256K |

Gemma 4:モデルの概要

LM Studio 0.4.9 での利用

最新の LM Studio アップデートLM Studio0.4.9 (build 1)では、Gemma 4 の能力を「安定」させるための重要なマイルストーンです。

ツール利用(Tool Use)の信頼性:

Gemma 4 が外部ツール(計算機、検索、APIなど)を呼び出す際のプロンプト理解が大幅に向上しました。

思考プロセスの制御:

Anthropic 互換の v1/messages 形式に対応し、output_config.effort(low, medium, high, max)によって、モデルが回答を生成する際のリソース投入量を制御可能になりました。

UIの堅牢性:

チャットフォルダ削除時のフリーズ解消や、Markdown リンクのポップオーバー表示のバグ修正など、長時間の開発作業に耐えうる安定性が確保されています。

LM Studio(GUI)での使い方

GUIでは、視覚的な操作で簡単にモデルをセットアップできます。

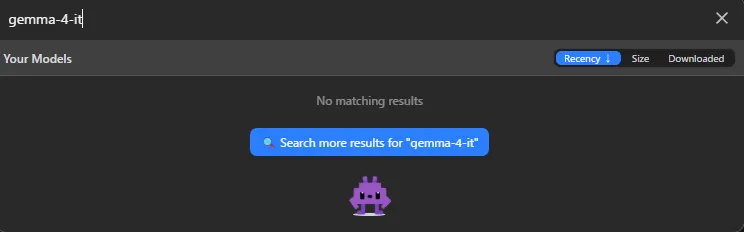

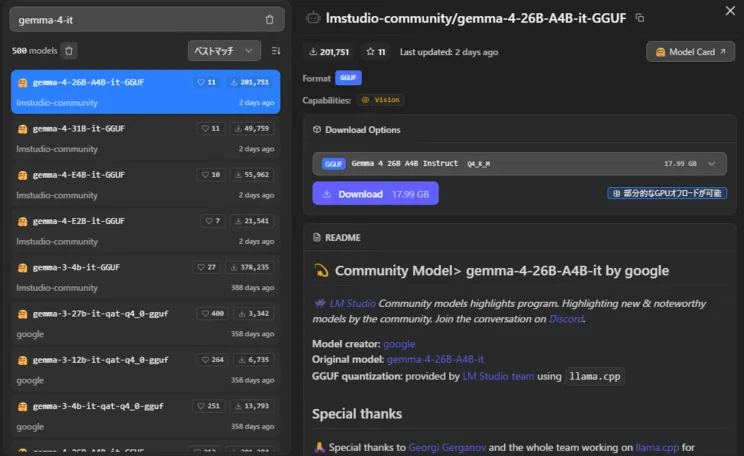

検索とダウンロード:

検索窓に gemma-4-it と入力し、lmstudio-community 版を選択します。

gemma-4-itの指定Vision機能の確認:

モデル名の横に Vision バッジがあることを確認してください。

lms コマンド(CLI)の利用

設定の確認

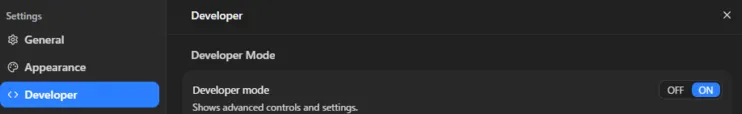

lms コマンド(CLI)をターミナルで使用するには、

Settings(設定)⚙️ > Developer(開発者向け) タブのDeveloper modeがONであることを確認します。

基本手順

- モデル確認:

lms lsでロード可能な Gemma 4 の正確なIDを確認。 - ロード:

lms load gemma-4-26b-a4b-itでメモリ(RAM/VRAM)へ展開。 - モード選択:

- 直接対話:

lms chat - APIとして運用:

lms server start(デフォルトでポート1234を使用)

- 直接対話:

コマンド一覧(Gemma 4 運用編)

| コマンド | Gemma 4 での活用例 | 詳細説明 |

lms ls | 正確なモデルIDの取得 | インストール済みの Gemma 4 (E2B や 26B) の正確な識別子を確認します。スクリプトに記述する際のミスを防ぎます。 |

lms load [ID] | スマートなメモリ展開 | 特定のモデルをロードします。LM Studio 0.4.9 では、VRAMとRAMの空き状況を自動的に判断し、最適なデバイスへ割り当てます。 |

lms unload --all | メモリの完全解放 | 26Bモデルなどの巨大なリソースを解放し、PCを通常の作業(コンパイルや動画編集など)に戻す際に必須です。 |

lms server start | 常駐型APIサーバー化 | lms chat を使わずに、バックグラウンドで推論エンジンを待機させます。自作ツールやPythonスクリプトからの呼び出しの起点となります。 |

lms status | 稼働リソースの監視 | 現在どのモデルがアクティブで、どれだけのメモリを占有しているかをリアルタイムで確認できます。 |

lms log | 推論プロセスの可視化 | ツール呼び出し(Tool Use)の成否や、推論中の内部エラーをデバッグするために使用します。 |

CLIでのマルチモーダル(画像解析)を実行

実行ワークフロー

- サーバー起動:

ターミナルでlms server startを実行し、APIを有効にします。 - 解析スクリプトの実行:

以下のスクリプト(vision_test.py)を使用して、画像をBase64エンコードして送信します。

import base64

import requests

IMAGE_PATH = r"画像ファイルへのパス"

API_URL = "http://localhost:1234/v1/chat/completions"

# 画像をエンコード

with open(IMAGE_PATH, "rb") as f:

base64_image = base64.b64encode(f.read()).decode('utf-8')

# APIへリクエスト送信

response = requests.post(API_URL, json={

"model": "gemma-4-26b-a4b-it",

"messages": [

{

"role": "user",

"content": [

{"type": "text", "text": "この画像を日本語で詳しく説明して。"},

{"type": "image_url", "image_url": {"url": f"data:image/jpeg;base64,{base64_image}"}}

]

}

]

})

print(response.json()['choices'][0]['message']['content'])このvision_test.pyを実行(python vision_test.py)することで、GUIを開かずに画像を解析できます。

実行手順

>lms server start

Success! Server is now running on port 1234

> python vision_test.py

この画像は、2つの異なるシーンを組み合わせたコラージュのような構成になっています。

**1. メインの画像(左側から中央にかけて):**

若い女性がシャワーを浴びている様子が写っています。彼女は目を閉じ、穏やかでリラックスした表情を浮かべており、シャワーの水しぶきを心地よく感じているようです。背景は白を基調としたタイル張りの壁で、清潔感のある明るい雰囲気です。水しぶきが細かく描写されており、動きと清涼感が伝わってきます。

**2. 右下の小さな画像:**

メインの画像とは別の角度、あるいは別のシーンとして、お風呂(浴槽)の一部が写っています。浴槽には水が張られており、そこから女性の足先(両足)が水面から少し出ている様子が見えます。これは、入浴によるリラクゼーションや、バスタイムのひとときを象徴しているようです。

**全体の印象:**

全体として「セルフケア」「リラクゼーション」「清潔感」「癒やし」といったテーマを感じさせる画像です。明るい光と白を基調としたトーンが、心地よいバスタイムの時間を強調しています。

>まとめ:ローカルAIの新時代

Gemma 4 と LM Studio 0.4.9 の組み合わせは、プライバシーを守りながら、商用AIに匹敵するパワーをローカルPCで使用できます。

特にマルチモーダル機能の CLI 活用は、大量のデータ処理を自動化する強力な武器となります。

参照リンク

- LM Studio 0.4.9 Release Notes:lmstudio-v0.4.9

- Hugging Face / LM Studio Community: Gemma 4 GGUF Models

- Google AI (Gemma Official): ai.google.dev/gemma

- LM Studio Changelog:ai/changelog